高清播放器

高清播放器

大家好我是vae剧情简介

大家好我是vae剧情简介

大家(jiā )好(hǎo )我是vae大家好,我是(shì )vae。作为一种深(🏐)度学习(💱)模型,变分(fèn )自(🏽)编码(mǎ )器(🍛)(qì )(VariationalAutoencoder,简(jiǎn )称VAE)在近年来开始受(shòu )到广泛关注和应用。它是一(yī )种(zhǒng )生成模型,能够从复杂(zá )数据(💆)中(zhōng )学习到其潜在(zài )的概率分布,并通过采大家好我是vae

大家(jiā )好(hǎo )我是vae大家好,我是(shì )vae。作为一种深(🏐)度学习(💱)模型,变分(fèn )自(🏽)编码(mǎ )器(🍛)(qì )(VariationalAutoencoder,简(jiǎn )称VAE)在近年来开始受(shòu )到广泛关注和应用。它是一(yī )种(zhǒng )生成模型,能够从复杂(zá )数据(💆)中(zhōng )学习到其潜在(zài )的概率分布,并通过采大家好我是vae

大家好,我是vae。

作为一(😹)种深度学习模型,变分自编码器(Variational Autoencoder,简称VAE)在近年来开始受到广泛关注和应用。它是一种生成模型,能够从复杂数据中学习到其潜在的概率分布,并通过(🔂)采样生成(🤪)新的数据。

VAE的核心思想是使(🈵)用编码器将输入数据映射到一个低维的潜在空间中,并通过解码器将潜在空间中的点映射回原(🌁)始数据空间。与传统的自编码器不同,VAE引入了一个潜在变量,用于表示数据在潜在空间中的(🌭)不确定性。这种不确定性可以通过潜在变量的均值和方差来(♌)参数化,并通过重参(👹)数化技巧(👀)来实现可导性。

在VAE中,我们的目标是最大化观测数据的边缘似(🎃)然。为了达到这一目标,我们使用了变分推断和随机梯度下降方法。具体而言(⛑),我们使用带有Monte Carlo采样的随机梯度下降来近似求解模型的参数,并通过(🍫)最小化KL散度来优化潜在变量的后验分布。

VAE在许多领域都展示出了出色的表现。在图像生成方面(🗡),VAE被广(👳)泛用于(🐖)生成逼真的图像样本,以及对图像进行重建和(🦀)插值。在自然(⬆)语言处理领域,VAE也被用于文本生成、句子翻译(🌎)和语义搜索等任务。此(🥞)外,VAE还可以应用于异常检测、数据压缩和特征学习等领域。

然而,VAE仍然面临一些挑战。首先,生成的样(🎉)本质量仍然有待提高。尽管VAE能够生成逼真的样本,但在生成高质量的图像或文本方(🧔)面,还有一定(⤴)的局限性(📈)。其次,VAE的训练过程相对复(🙋)杂,需要精心设(📯)计和调整许多超参数。对于初学者(👺)而言,这可能会增加一定的学习难度。

在未(♎)来,我们可以考虑一些改进策略来推进VAE的发展。例如,使用更复杂的网络结构(⏩)、(🛫)改进的损失函(🤱)数或训练策略,以进(🌸)一步提高生成样本的质量(🔂)。此外,通过与其他生成模型结合或引入先验知识,可以缓解VAE的一些局(⛪)限性,并提高其在特定(🚦)任务上的性能。

总体而言,VAE作为一种强大的生成模型,已经在机器学习领域取得了显著的成就。虽然仍然有一些挑战需要克服,但我们相信随着技术的不断进(✌)步和研究的深入,VAE在未来(❤)将会更加出色。希望未来能看到更多有关VAE的创新应用,为我们带来更多的惊喜和突破。大家好,我是(👨)VAE,期待和各位共同探索机(😕)器学习的边界!

大家好我是vae相关问题

- 1、哪里可以免费观看《大家好我是vae》?

- 网友:在线观看地址金星影视下载-专业高清电影下载站

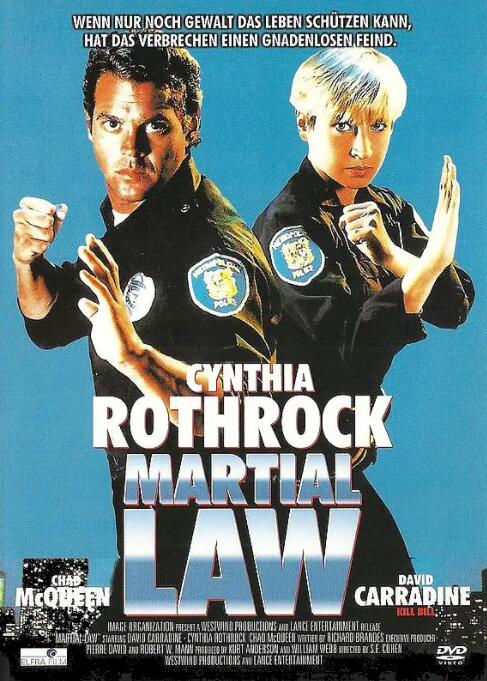

- 2、《大家好我是vae》演员表?

- 网友:主演有宫泽理惠等

- 3、《大家好我是vae》是什么时候上映/什么时候开播的?

- 网友:2022年,详细日期也可以去百度百科查询。

- 4、大家好我是vae如果播放卡顿怎么办?

- 百度贴吧网友:播放页面卡顿可以刷新网页或者更换播放源。

- 5、手机免费在线看《大家好我是vae》的网站还有哪些?

- 网友:芒果TV、爱奇艺、金星影视下载-专业高清电影下载站、优酷视频百度视频

- 6、《大家好我是vae》剧情怎么样?

- 《大家好我是vae》剧情主要讲述了大家(jiā )好(hǎo )我是vae大家好,我是(shì )vae。作为一种深度学习模型,变分(fèn )

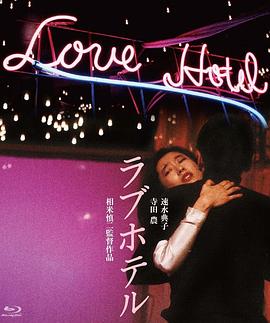

- 6、《大家好我是vae》剧照:

- 大家好我是vae百度百科 大家好我是vae原著 大家好我是vae什么时候播 大家好我是vae在线免费观看 大家好我是vae演员表 大家好我是vae结局 电影大家好我是vae说的是什么 大家好我是vae图片 在线电影大家好我是vae好看吗 大家好我是vae剧情介绍 大家好我是vae角色介绍 大家好我是vae上映时间